A quoi sert le LiDAR, le nouveau capteur de l’iPhone 12 Pro

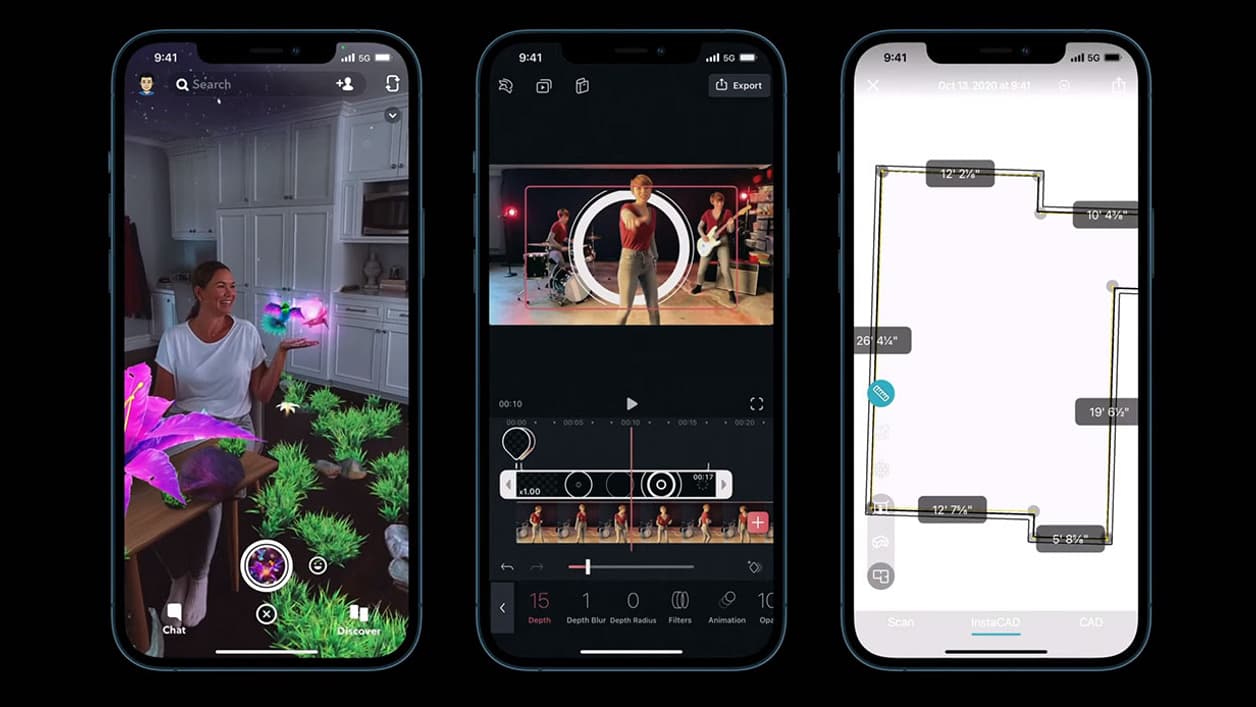

Un filtre Snapchat tirant profit du capteur LiDAR de l'iPhone 12 Pro - Apple

Si le design des iPhone 12 Pro se démarque peu de celui des iPhone 11 Pro (marqué par la présence d'un triple module caméra), un discret capteur vient toutefois s'ajouter au dos du nouveau modèle très haut de gamme d'Apple, commercialisé à partir de 1159 euros. Il s'agit d'un scanner LiDAR, dédié à la télédétection par laser. Une forme de radar, utilisé dans l'industrie spaciale ou dans le développement de la voiture autonome, capable de cartographier un environnement en trois dimensions.

A la différence du classique radar, capable d'estimer une distance en évaluant le temps qu'il faut à une onde radio pour effectuer un aller-retour vers un objet, le LiDAR évalue le temps qu'il faut à la lumière pour effectuer cette même opération. De nombreux faisceaux lumineux sont émis simultanément, pour matérialiser un environnement dans son ensemble.

Notons que la technologie LiDAR, déjà utilisée sur le dernier iPad Pro, est voisine de celles qui sont intégrés aux capteurs "de temps de vol" (ToF), que l'on retrouve notamment sur les derniers mobiles Samsung et Huawei.

Réalité augmentée et photo

Le premier usage de la technologie LiDAR concerne logiquement la réalité augmentée. Ainsi, les applications proposant par exemple de choisir un meuble à distance en simulant se représentation au milieu de son salon devraient être plus précises qu'auparavant. Des applications de divertissement en profiteront également, à l'image de Snapchat qui, lors de la conférence d'Apple, a dévoilé un filtre inédit (à gauche sur l'image ci-dessous), plus évolué que les autres, et réservé à l'iPhone 12 Pro.

Des informations concernant la modélisation de l'environnement sont également précieuses en photo, notamment pour la mise au point. Ces données aident ainsi l'appareil à faire le point sur le premier plan avec bien plus de facilité, notamment dans des conditions de faible éclairage. Là encore, Samsung utilise des capteurs "de temps de vol" dans le même but.

Chez Apple, le LiDAR est utilisé pour accélérer cette mise au point en basses lumières. Le fabricant promet que le processus sera jusqu'à six fois plus rapide qu'auparavant. Par ailleurs, le fait d'analyser l'environnement en 3D permet aux algorithmes de photo d'Apple de détacher l'arrière-plan du premier plan - opération indispensable pour appliquer le flou du mode portrait - y compris dans ces conditions plus difficiles. Sur l'iPhone 12 Pro, il est donc possible d'immortaliser des portraits, y compris en mode Nuit.