Une Google Car devra-t-elle choisir de sacrifier ses passagers?

L'un des prototypes de voiture autonome sans volant ni pédale de Google. - Google

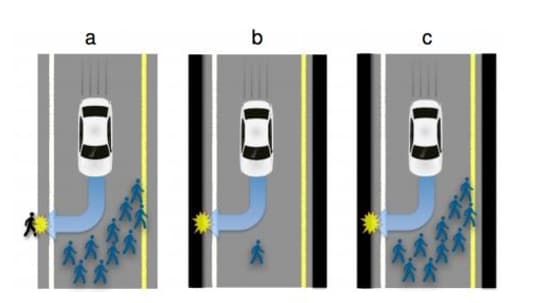

"Un accident est inévitable. A: la voiture autonome continue son chemin et percute un piéton ; B: elle fait une embardée et tue son passager." Ceci n’est pas un exercice du code de la route mais un cas de figure soumis par un groupe de chercheurs en psychologie à des internautes.

Jean-François Bonnefon, de la Toulouse School of Economics, Azim Shariff, de l’Université de l’Oregon et Iyad Rahwan, du MIT Media Lab, ont mené trois séries d’études au mois de juin dernier en utilisant une plateforme en ligne pour sonder deux milliers d’Américains sur la question des voitures autonomes. Leurs conclusions, présentées dans un article provisoire au mois d'octobre dernier, sont enfin parues ce 24 juin dans la revue Science.

Percuter un motard ou rentrer dans un mur ?

Et le résultat est sans appel. "La grande majorité des internautes, 75% exactement, a réclamé le sacrifice du passager plutôt que celui du piéton", nous a expliqué Jean-François Bonnefon. Ils étaient beaucoup moins nombreux, bien sûr, à opter pour cette solution si on leur demandait de s’imaginer à bord du véhicule.

D’autres situations leur étaient exposées, comme choisir d’écraser un groupe de piétons ou un seul passant, ou encore rentrer dans un mur ou faucher un motard. "Il ne s’agissait pas d’obtenir un pourcentage mais plutôt de situer les réponses sur une échelle afin d’obtenir les variantes les plus fines possibles", détaille Jean-François Bonnefon.

Petites merveilles de technologie capables d’éviter davantage d’accidents que les hommes, les voitures sans pilote ne pourront pas faire abstraction des dilemmes éthiques qui se poseront forcément au cours de leur pérégrinations. Jusqu’où sommes-nous enclins à aller en matière de sécurité ? Serons-nous prêts à acheter une voiture programmée pour choisir potentiellement de nous tuer ?

Fabricants et régulateurs devront donc prendre en compte ce que la population sera prête à tolérer. Les algorithmes devront accomplir trois objectifs à priori incompatibles: obtenir un comportement cohérent du véhicule, ne pas causer l'indignation du public, et… ne pas décourager les acheteurs. Et pour les auteurs de cet article, l’éthique expérimentale peut apporter des réponses.

Jean-François Bonnefon envisage maintenant de poursuivre ses travaux en enrichissant son questionnaire avec de nouveaux cas de figures, comme la présence d’enfants à bord d’un véhicule autonome, ou encore le risque de blessures.