YouTube doute de ses algorithmes pour sélectionner les contenus destinés aux enfants

L’annonce sonne comme un aveu d’échec. A la suite d'une série de déboires, YouTube Kids, la version de YouTube réservée aux enfants, s’en remettra à une équipe de modérateurs humains pour sélectionner les vidéos présentes sur sa plateforme, rapporte BuzzFeed News.

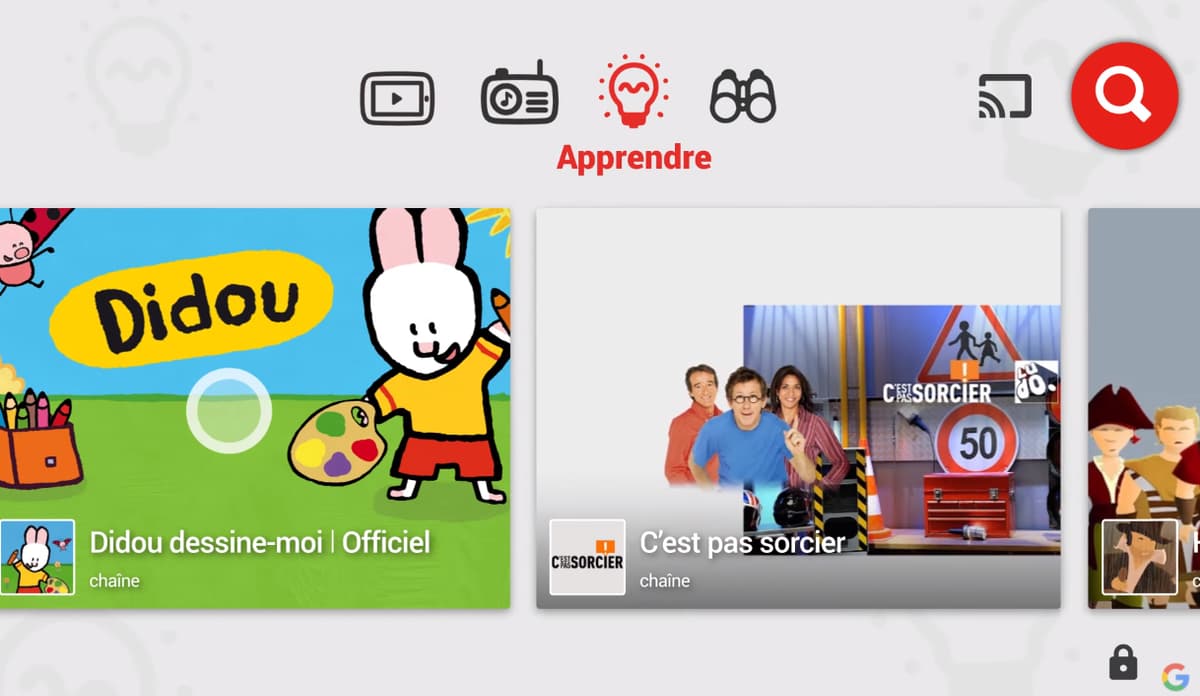

Version édulcorée de sa grande sœur YouTube, YouTube Kids promet aux parents de formuler des recommandations de vidéos inoffensives, afin de laisser leur progéniture naviguer sur la plateforme l'esprit tranquille. La sélection était jusqu'à présent élaborée par des algorithmes. Ces derniers se sont néanmoins avérés faillibles à plusieurs reprises.

Mi-mars, YouTube a été accusé par Business Insider d'exposer son jeune public (3-9 ans) à des vidéos conspirationnistes, dont certaines arguant que la Terre était plate, ou que le monde était dominé par des reptiliens, cette espèce mi-homme mi-lézard. En fin d'année dernière, The Verge avait noté la présence intrusive de commentaires à teneur pédophile, non modérés, sous les vidéos regardées par les enfants. Autant d'exemples qui ne correspondent pas véritablement à la promesse initiale du service.

Aucun droit à l'erreur

La sélection humaine de vidéos, qui prendra la forme d'une option sur YouTube Kids, sera lancée ces prochaines semaines, selon les informations de BuzzFeed. YouTube n’a pas démenti une telle initiative, sans pour autant la confirmer. "Nous travaillons en permanence pour mettre à jour et améliorer YouTube Kids, mais ne commentons ni rumeur ni spéculation", a simplement indiqué l'entreprise.

La modération des contenus sensibles est un travail de longue haleine pour les géants du Web. Ces entreprises sont régulièrement critiquées pour leur difficulté à endiguer les contenus haineux, violents ou liés à du harcèlement.

YouTube prend le problème à bras le corps depuis plusieurs mois. En novembre 2017, 150.000 vidéos violentes ou mettant en scène l'exploitation d'enfants ont été retirées de YouTube Kids. En décembre dernier, YouTube a annoncé son souhait de constituer une équipe de 10.000 modérateurs d'ici la fin de l'année, soit une hausse de 25% par rapport aux effectifs actuels.

Ces recrues seront à la fois chargées de repérer les contenus sensibles, polémiques ou violant les conditions d'utilisation de la plate-forme, mais aussi d'entraîner les algorithmes développés par YouTube à repérer plus rapidement et plus efficacement les vidéos à supprimer. Car aussi complexes et perfectionnés soient-ils, les algorithmes ne sont pas la solution à tout, en tout cas pour le moment.