Faut-il poser des limites aux algorithmes qui régissent notre société ?

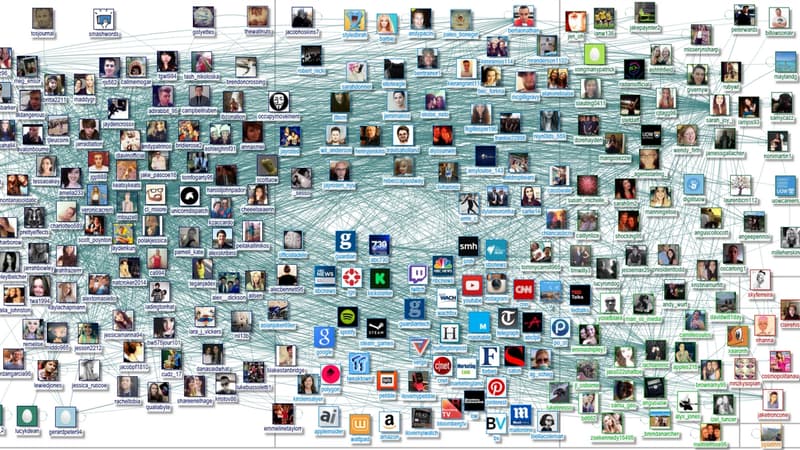

Graphe relationnel Twitter créé par un algorithme - Chris Moore (Creative Commons)

On ne les voit pas, on ne les sent pas, on ne les entend pas. Et pourtant, ils sont partout et régissent de plus en plus notre vie. Parfois, ils décident même de la mort de certains humains. A mesure qu'augmentent l'interconnexion et la capacité de traitement des systèmes informatiques, les algorithmes deviennent de plus en plus importants dans les processus de décision.

Ils permettent de classer des informations (moteur de recherche), fixer un prix de billet d'avion (yield management), affecter des forces de gendarmerie (analyse prédictive), établir une liste de suspects terroristes (loi française sur le renseignement), créer des cibles terroristes (frappes de drones américains), répartir des élèves ou des étudiants en lycée ou en université (Affelnet, Admission Post Bac), identifier les acheteurs potentiels d'un produit (ciblage publicitaire), détecter une fraude bancaire, ou encore cerner les mauvais payeurs, etc.

Mais cette omniprésence commence à poser problème et plusieurs chercheurs se penchent désormais sur ce sujet. "Les algorithmes influencent de plus en plus notre vie. Pourtant, les critères qu'ils manipulent ne sont pas forcément neutres, leurs conclusions ne sont pas forcément corrects, et en plus ils sont généralement assez opaques", explique Daniel Le Métayer, directeur de recherche à l'Inria, à l'occasion d'une récente conférence organisée par France Stratégie, un organisme de réflexion placé auprès du Premier ministre.

Discrimination, distorsion, injustice

L'algorithme en soi n'est pas mauvais. Généralement, il a été créé pour simplifier ou accélérer une tâche. Mais ce qui importe, c'est comment et dans quel cadre il est utilisé. "Les algorithmes peuvent nous rendre plus ouverts et plus attentifs à certains détails. Mais ils peuvent aussi devenir toxiques quand ils soutiennent un état de fait insoutenable", explique Antoinette Rouvroy, chercheuse qualifiée à l'université de Namur, qui est également intervenue à cette conférence. C'est le cas, par exemple, quand ils provoquent une distorsion de concurrence (recherche Google) ou une discrimination d'une catégorie de citoyens (les malades vis-à-vis des non-malades face à une demande de crédit).

Mais comment faire pour poser des limites à un algorithme? De l'avis de ces deux chercheurs, la première chose serait d'instaurer un minimum de transparence. Mais attention, cela n'implique pas la publication d'un code source, souvent intelligible au commun des mortels. "Il faut être capable d'extraire des traits distinctifs permettant d'apprécier son fonctionnement", souligne Daniel Le Métayer. "Une transparence sur les données utilisées serait également souhaitable ", ajoute Antoinette Rouvroy.

Sentiment de révolte

Une première réponse en ce sens a été donnée par le gouvernement dans le cadre de son projet loi sur la République numérique. Adopté le 26 janvier dernier en première lecture à l'Assemblée nationale, celui-ci propose "un droit d'accès aux règles définissant les traitements algorithmiques" des administrations (article 2). Chaque personne devrait ainsi pouvoir connaître et contester une logique algorithmique utilisée dans un cadre public. Reste à savoir comment cette mesure sera mise en oeuvre. Il est probable, par ailleurs, que les algorithmes de détection des suspects terroristes en soient exclus.

Dans la sphère privée, les choses risquent toutefois d'être plus compliquées. La transparence peut se heurter à la propriété intellectuelle, au secret industriel ou, tout simplement, à la logique d'efficacité. Publier le fonctionnement de l'algorithme de recherche de Google rendrait celui-ci immédiatement caduque: chaque éditeur de site essaierait alors de le contourner. Et quand un système est totalement fermé, l'analyse est forcément limitée.

Pourtant, si cette opacité perdure et s'intensifie, elle risque de provoquer des crispations, voire des révoltes. "L'opinion publique est assez opposée à ce que des systèmes opaques prennent des décisions. C'est également lié à la crainte que les hommes puissent être remplacés par des machines", souligne Antoinette Rouvroy. Bientôt, il faudra peut-être faire la révolution contre les algorithmes.