"Ce cauchemar doit cesser": un activiste poursuit Meta après avoir vu ce que son IA dit à son sujet

De fausses informations qui portent préjudice. Depuis le 28 avril, Meta est visé par une plainte pour diffamation déposée par Robby Starbuck, cinéaste, journaliste et activiste américain. Cela, à cause de son assistant Meta AI. Selon la plainte, l'outil a "diffusé et continue de diffuser des déclarations manifestement fausses et diffamatoires accusant à tort Starbuck d'avoir participé à l'émeute du Capitole du 6 janvier et d'avoir été arrêté pour un délit mineur".

L'activiste se trouvait pourtant à un bon millier de kilomètres de Washington le 6 janvier 2021. Il était chez lui dans le Tennessee. Comme l'indique le Wall Street Journal, Robby Starbuck a découvert que les fausses déclarations de Meta AI à son sujet l'été dernier, alors qu'il menait une campagne en ligne pour inciter le constructeur Harley-Davidson à modifier ses politiques en matière de diversité, équité et inclusion (DEI).

Un concessionnaire Harley a alors riposté en publiant, sur X, une capture d'écran censée représenter une réponse de l'assistant de Meta, indiquant que le cinéaste était présent lors de l'assaut du Capitole, mais aussi qu'il était lié au mouvement complotiste QAnon.

Menaces de mort

Depuis, Robby Starbuck a utilisé le réseau social d'Elon Musk pour demander aux dirigeants de Meta, y compris son PDG Mark Zuckerberg, de retirer ces fausses informations. Son avocate a également envoyé une lettre de mise en demeure au groupe californien. Si l'entreprise a répondu en assurant "prendre au sérieux les affirmations contenues dans votre lettre" et mener une enquête à ce sujet, cela n'a rien changé.

"Même après avoir accusé réception de la demande officielle de Starbuck en août 2024, Meta a permis à son IA de continuer à le diffamer pendant des mois, finissant par élargir le faux récit pour y inclure des allégations fabriquées de toutes pièces, telles que le négationnisme de l'Holocauste et des affirmations selon lesquelles il n'était pas apte à élever ses propres enfants", indique la plainte.

À cause de ces fausses informations, Robby Starbuck et sa famille ont reçu des menaces de mort. Elles ont aussi porté atteinte à sa carrière et lui ont fait perdre des opportunités commerciales cruciales.

"Ce cauchemar doit cesser (...) Cette affaire trace une ligne claire: l'IA doit avoir des garde-fous. J'exhorte Mark Zuckerberg et les dirigeants de Meta à se remettre en question et à régler ce problème pour le bien de la prochaine génération", a déclaré l'activiste.

"Si Meta veut trouver un accord, il doit s'engager à apporter des changements à long terme pour protéger tout le monde contre la diffamation induite par l'IA", a-t-il souligné, espérant obtenir plus de cinq millions de dollars de dommages et intérêts avec son action en justice.

L'activiste n'est en effet pas le seul à vouloir que les entreprises d'IA soient tenues responsables des informations fausses et préjudiciables diffusées par leurs outils. En mars, un Norvégien a par exemple porté plainte contre OpenAI après que ChatGPT a affirmé qu'il avait tué deux de ses enfants et d'avoir tenté d'assassiner le troisième.

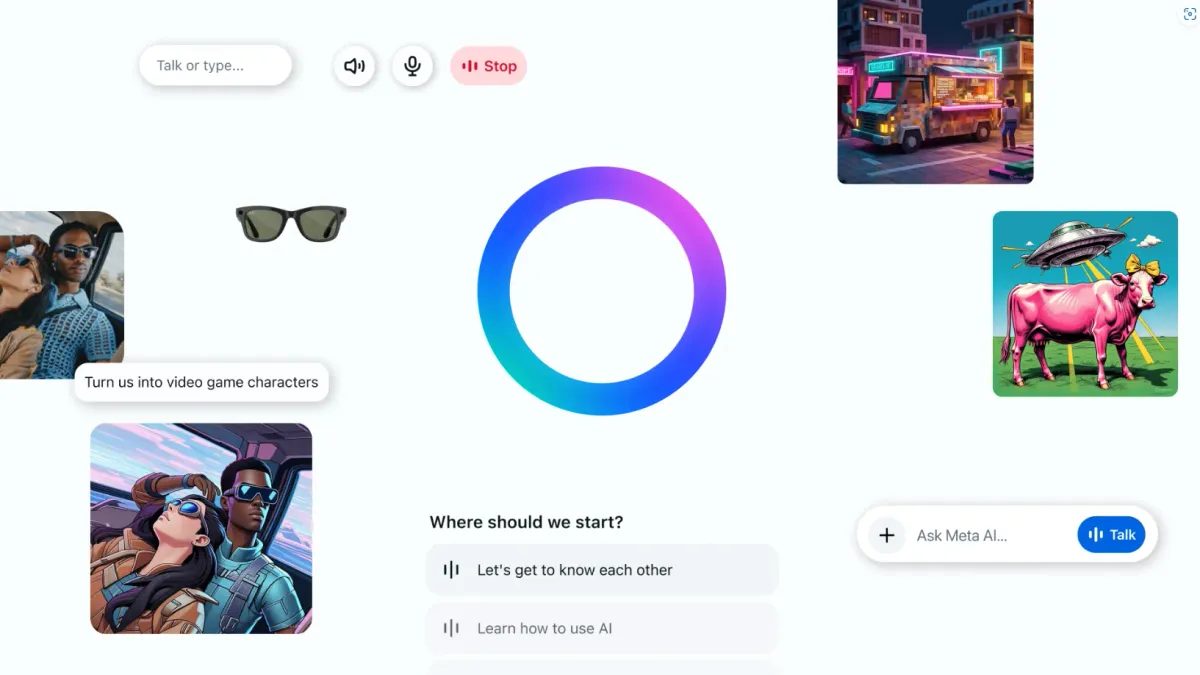

Dans le cas de Robby Starbuck, Meta AI a rendu plus difficile la recherche d'informations à son sujet en avril. "Désolé, je ne peux pas vous aider pour l'instant", a répondu l'assistant à des requêtes le concernant d'après la plainte. La fonction vocale de l'outil continue néanmoins de générer de fausses informations sur l'activiste, affirmant notamment qu'il avait plaidé coupable de trouble à l'ordre public lors de l'assaut du Capitole.

Face à cette plainte, Meta s'est défendu en assurant avoir publié des mises à jour "dans le cadre nos efforts continus pour améliorer nos modèles". "Nous continuerons à le faire", a ajouté l'entreprise.