ChatGPT peut aussi falsifier les notes de frais

Depuis son lancement, le nouveau générateur d'images de ChatGPT surfe sur une vague de popularité. Capable de créer des images, il peut aussi en transformer d'autres qui existent déjà. De nombreux utilisateurs s'en sont servis à cet effet, transformant des photos iconiques en dessins animés.

Les capacités de ce générateur peuvent cependant être utilisées à mauvais escient. Comme le relate le site spécialisé Techcrunch, certains s'en servent déjà pour générer de faux reçus assez réalistes.

Investisseur en capital-risque, Deedy Das a par exemple généré un faux reçu du restaurant américain de grillades Epic Steak, avec aucune erreur au niveau des prix. Sa fausse image a été reprise par Michael Gofman, professeur à l'université hébraïque de Jérusalem, qui a voulu la rendre plus réelle en y ajoutant des tâches de nourriture et de boisson.

Falsification avec réalisme

Avec le générateur de ChatGPT, il est même possible de falsifier un vrai reçu, ce qu'a fait Raphael Chenol, directeur Digital Learning au Ynov Campus. Il a utilisé un vrai ticket du restaurant Hippopotamus et remontant à décembre 2024, demandant au chatbot de changer la date et le prix.

Chose que ChatGPT a fait avec réalisme. "Mon application de saisie de notes de frais n'y voit que du feu. Oui, ça ne prend que quelques secondes là où avant il fallait des skills (compétences, NDLR) en Photoshop", a écrit Raphael Chenol sur Linkedin.

"Alors je ne suis pas là pour donner le mauvais exemple, je ne risquerais pas de me faire virer pour fraude par mon employeur. Mais quand on passe son temps à parler éthique dans le cadre de l'IA, il est important de dénoncer les abus possibles", a précisé Raphael Chenol.

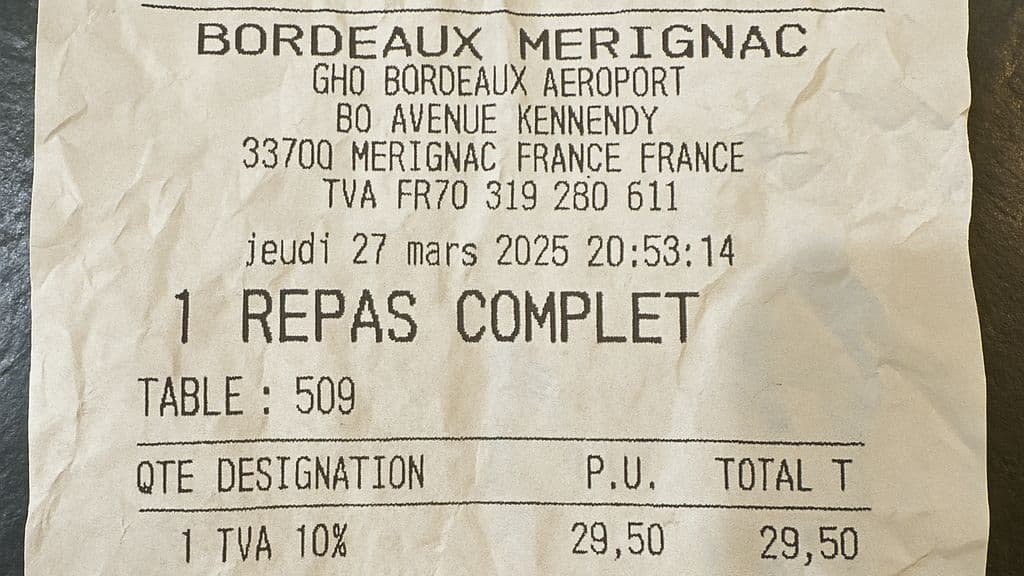

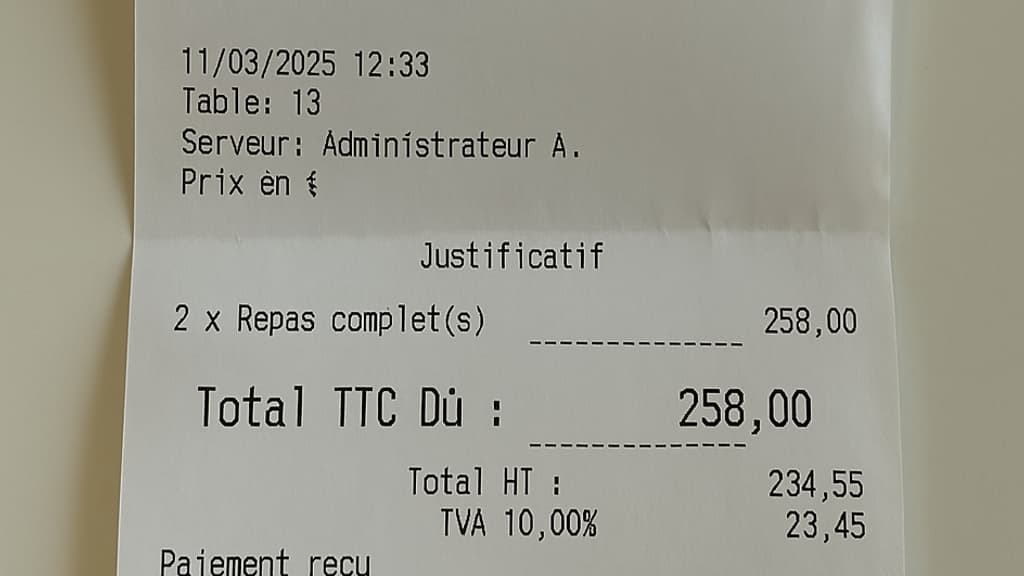

Testé par Tech&Co, le générateur a également changé le montant d'un vrai reçu de façon convaincante, le faisant passer de 52 euros à 258 euros.

Le générateur d'images de ChatGPT pourrait en effet être utilisé pour de la fraude. Le fait qu'il puisse falsifier de vrais reçus sans problème est d'ailleurs étonnant, car la politique d'utilisation d'OpenAI interdit d'utiliser les données de sortie, soit les images générées par l'outil dans le cas présent pour frauder ou escroquer.

À ce sujet, une porte-parole d'OpenAI a déclaré, auprès de Techcrunch que l'objectif de l'entreprise était de "donner aux utilisateurs tant de liberté créative que possible". Le créateur de ChatGPT estime que les faux reçus pourraient être utilisés dans des situations non frauduleuses, comme "l'enseignement de la culture financière" ou pour créer des oeuvres d'art et des publicités pour des produits.